Am 01. Dezember 2018 begann dieses vom Österreichischen Wissenschaftsfonds in Kooperation mit dem Land Steiermark geförderte Forschungsprojekt der Partner Technische Universität Graz, Universität Graz und University of Chile in Kooperation mit der österreichischen Akademie der Wissenschaften [1]. Ziel unseres Vorhabens ist es, neue Methoden für die visuelle inhaltsbasierte Suche, den Vergleich und die Exploration von Kulturgutobjekten über verschiedene Repräsentationen hinweg zu entwickeln. Im Fokus stehen hierbei sowohl 2D Repräsentationen wie Bildaufnahmen und Skizzen, aber auch 3D Digitalisate und textuelle Beschreibungen. Durch einen cross-modalen Zugang sollen Such- und Vergleichsarbeiten, wie sie bei der archäologischen Bestimmung und Analyse von Kulturgutobjekten anfallen, unterstützt werden. Durch eine automatisierte Suche sollen große Mengen von visuellen Objektdaten effizient auf Übereinstimmungen und Ähnlichkeiten bezüglich einer Suchanfrage gefunden und geordnet werden, und hierdurch der manuelle Rechercheaufwand reduziert werden. Darüber hinaus können durch geeignete Suchmethoden Grenzen zwischen verschiedenen Repräsentationen überwunden werden, indem z.B. anhand eines 3D digitalisierten Objektfragments nach ähnlichen Vorkommen in Bilddatenbanken, Zeichnungen oder allgemeinen Publikationen gesucht werden kann. Neben der Herausforderung einer Suche entlang verschiedener Objektmodalitäten stellt sich auch häufig das Problem der Unvollständigkeit vorliegender Suchobjekte, sodass die Suche auch lokale (Teil-)Ähnlichkeiten erkennen soll.

Hintergrund

Die Digitalisierung und digitale Verarbeitung von Objektdaten eröffnet zahlreiche neue Anwendungen in der Archäologie, von denen wir hier nur einige benennen können. Digitale Objekte können in virtuellen Ausstellungen verteilt präsentiert oder in digitalen Bibliotheken langzeitarchiviert werden. Verschiedene Online-Repositorien beinhalten bereits heute eine große Anzahl von digitalen Objektdaten und bieten diese für die Forschung an, so z.B. das Corpus Vasorum Antiquorum Online (http://www.cvaonline.org/cva/) bzw. das Beazley Archiv (http://www.beazley.ox.ac.uk/index.htm), um nur zwei Beispiele unter mehreren aus dem Bereich antiker Gefäße zu nennen. Methoden des Geometric Matching [2] unterstützen die Rekonstruktion von Objekten aus Fragmenten [3]. Die Simulation und Visualisierung von Erosionsprozessen [4] kann bei der Planung von Erhaltungsmaßnahmen dienen. Darüber hinaus unterstützt der quantitative Vergleich von 3D Oberflächenformen die archäologische Theoriebildung [5].

Eine Querschnittsaufgabe der archäologischen Forschung stellt die visuelle Suche bzw. der visuelle Vergleich von Objekten dar. Bei der Objektsuche kann grundsätzlich zwischen metadatenbasierter und inhaltsbasierter Suche unterschieden werden. Ersterer Ansatz basiert üblicherweise auf der Verwendung von manuell erfassten, beschreibenden Objektdaten wie Bezeichnungen, Fundorte, Jahresangaben etc., die zur Suche verwendet werden. Diese Metadaten müssen in ausreichender Qualität, Quantität und Konsistenz erfasst sein, um die Suche effektiv zu unterstützen. Gleichzeitig ist die Suche dann auf diese vorhandenen Metadaten beschränkt. Bei der inhaltsbasierten Suche werden hingegen automatisch extrahierte Objektmerkmale (Features) verwendet. Dieser Ansatz kann gut mit der Größe und Heterogenität der Objektbestände skaliert werden, benötigt jedoch entsprechende geeignete Merkmalsextraktoren. Für die visuelle Suche wurden in der Literatur bereits vielfältige Verfahren zur Extraktion vordefinierter oder auch gelernter Merkmale in Bild- und 3D-Objektdaten vorgeschlagen [6]. Eine Herausforderung besteht darin, für die Anwendung geeignete Merkmalsextraktoren zu identifizieren, welche die gewünschten Sucheigenschaften erfüllen. In unserem Projekt sind dies die Unterstützung unterschiedlicher Objektrepräsentationen (Bild, Skizze, 3D-Objekt) und Objekteigenschaften (vollständig/unvollständig, Form, Textur bzw. Motive).

Prototyp für die Formsuche mittels 3D Objekten und Skizzen

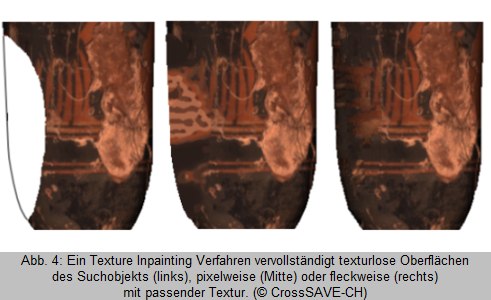

Im Vergleich zu herkömmlichen Formsuchanfragen unterstützt der von uns realisierte Suchprozess auch 3D-Anfrageobjekte, die nur unvollständig bzw. fragmentarisch vorliegen. Um die Suche hierbei zu unterstützen, wurde ein geeigneter semi-interaktiver Vorverarbeitungsmechanismus realisiert. Dieser erlaubt es, unvollständige Objekte mittels Skizzenzeichnungen zu vervollständigen (Abb. 3). Nachdem die Form (Umriss) durch die Skizze komplettiert wurde, wird mittels eines Texture-Inpainting Verfahrens die fehlende Objekttextur ergänzt (Abb. 4).

Im Rahmen des Projektes wurde durch die Forschungspartner ein erster Prototyp (Abb. 1) für die visuelle Suche in Objektdaten konzipiert und implementiert [7]. Ausgehend von einem 3D Suchobjekt werden ähnliche Objekte aus einer Bilddatenbank anhand von Bildmerkmalen gefunden und nach Ähnlichkeit gereiht präsentiert (Abb. 2).

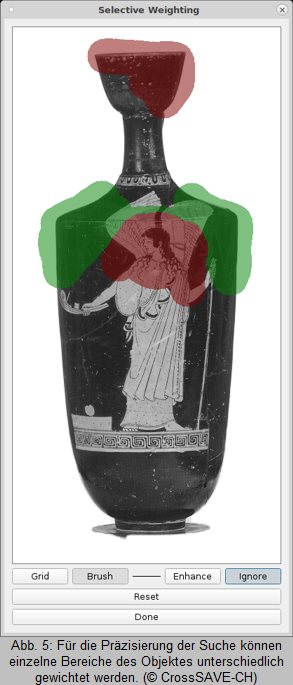

Das so vervollständigte Suchbild wird dann anhand von geeigneten Bildmerkmalen mit den Zielbildern verglichen und die ähnlichsten gereiht zurückgeben. Als Bildmerkmale verwenden wir Gradienten- und Farbeigenschaften, die bei Bedarf interaktiv lokal gewichtet werden können. Unser Ansatz erlaubt neben der Suche nach vollständigen Objekten auch zu überprüfen, ob bestimmte angenommene, rekonstruierte Formen vorhanden sind. Dadurch können z.B. Hypothesen über das Vorhandensein von bestimmten Formen in einer Sammlung überprüft werden. Durch Setzen von Schwerpunkten mittels einer entsprechenden Benutzeroberfläche (Abb. 5) kann die Suchanfrage noch weiter präzisiert werden.

Das so vervollständigte Suchbild wird dann anhand von geeigneten Bildmerkmalen mit den Zielbildern verglichen und die ähnlichsten gereiht zurückgeben. Als Bildmerkmale verwenden wir Gradienten- und Farbeigenschaften, die bei Bedarf interaktiv lokal gewichtet werden können. Unser Ansatz erlaubt neben der Suche nach vollständigen Objekten auch zu überprüfen, ob bestimmte angenommene, rekonstruierte Formen vorhanden sind. Dadurch können z.B. Hypothesen über das Vorhandensein von bestimmten Formen in einer Sammlung überprüft werden. Durch Setzen von Schwerpunkten mittels einer entsprechenden Benutzeroberfläche (Abb. 5) kann die Suchanfrage noch weiter präzisiert werden.

Ergebnisse

Das Suchsystem wurde bereits erfolgreich auf Daten von archäologischem Interesse, speziell aus der antiken Gefäßforschung, erprobt. Hierzu konnten wir mit mehr als einem Dutzend 3D Objekten, bereitgestellt durch das Landesmuseum Kärnten, experimentieren. Die Objekte repräsentieren attisch schwarzfigurige Lekythoi aus der ersten Hälfte des 5.Jhs. v.Chr. und damit sehr typische Gefäße aus dieser Epoche. Um die Eigenschaften der Suche nach unvollständigen Objekten zu erproben, wurden einige Teile der Geometrie manuell entfernt und somit unterschiedliche Erhaltungszustände simuliert. Durch Domänenexperten wurden anschließend verschiedene Skizzen von unterschiedlichen plausiblen Ergänzungen erstellt, die schließlich für die Evaluierung der Qualität der Suchergebnisse verwendet wurden. Als Suchrepositorium haben wir die zwei Bände Berlin 13 und 17 des Corpus Vasorum Antiquorum (CVA) ausgewählt, welche fachlich zu den Suchobjekten passen. Mittels einer geeigneten Kette von automatisierten Bildverarbeitungsmethoden, einschließlich Erkennung von Abbildungen, Vordergrund-/Hintergrund-Segmentierung und Bildzuschnitt, wurden aus den Bänden jeweils 114 bzw. 230 Gefäßbilder extrahiert.

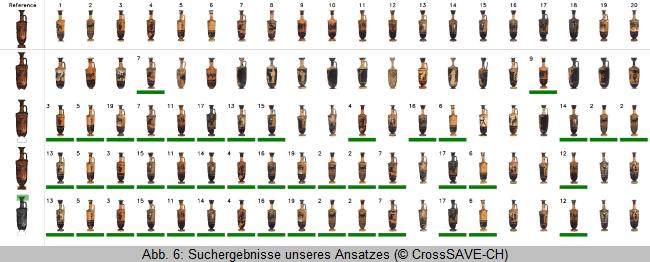

Von Domänenexperten vom Institut für Archäologie der Universität Graz wurden aus den CVA Abbildungen eine Anzahl an Suchanfragen und relevanten Objekten definiert, welche zur Evaluierung der Korrektheit unserer bildbasierten Suche herangezogen wurde. Abbildung 6 illustriert Suchergebnisse zu einem unvollständigen Objekt anhand der verschiedenen Möglichkeiten unserer Suche. Die oberste Reihe zeigt die Menge korrekter Suchergebnisse zu einer Anfrage, die durch das System idealerweise aufgefunden werden sollen. Die Suche mit einem unvollständigen Objekt (2. Reihe von oben) liefert keine erwarteten Ergebnisse, da die Formunterschiede zu hoch sind. Es zeigt sich, dass jedoch mittels Ergänzung einer Skizze gute Suchergebnisse erzielt werden können. Allein durch das Skizzieren einer vervollständigenden Silhouette (dritte Reihe) werden bereits 13 relevante Objekte unter den ersten 20 Plätzen gefunden. Durch Miteinbeziehung eines Texture-Inpainting Schrittes erhöht sich die Suchgenauigkeit um ein weiteres relevantes Objekt (4. Reihe). Darüber hinaus kann durch die interaktive Gewichtung von Regionen in der Suchanfrage das Ergebnis weiter auf 15 relevante Objekte verbessert werden (unterste Reihe).

Wenn gewünscht, erlaubt unser System

Wenn gewünscht, erlaubt unser System

auch einen paarweisen visuellen Vergleich des Suchobjektes mit den einzelnen Suchergebnissen, um Ähnlichkeiten und Abweichungen im Detail zu analysieren. Hierzu werden Such- und Ergebnisobjekt semitransparent übereinandergelegt, und die Abweichungen zellenbasiert mittels einer Farbcodierung dargestellt (Abb. 7). Ein Video zur Demonstration eines Suchlaufes mit unserem Systems findet sich hier (mp4).

auch einen paarweisen visuellen Vergleich des Suchobjektes mit den einzelnen Suchergebnissen, um Ähnlichkeiten und Abweichungen im Detail zu analysieren. Hierzu werden Such- und Ergebnisobjekt semitransparent übereinandergelegt, und die Abweichungen zellenbasiert mittels einer Farbcodierung dargestellt (Abb. 7). Ein Video zur Demonstration eines Suchlaufes mit unserem Systems findet sich hier (mp4).

Nächste Schritte

Aufbauend auf diesen Ergebnissen eröffnen sich weitere interessante Fragestellungen, wie die Suche und Exploration von Kulturgutobjekten durch Informationstechnologie unterstützt werden kann. Erweiterungsmöglichkeiten bestehen zum einen bei den verwendeten merkmalsbasierten Ähnlichkeitsfunktionen. Neben den bereits verwendeten Merkmalen Form und Textur können je nach Anwendung weitere Merkmale relevant sein, wie z.B. die Struktur eines Objektes, oder vorhandene feine Details, wie etwa Rillen oder angebrachte Ornamente. Darüber hinaus können für die Ähnlichkeitsbewertung auch die Formen von auf den Objekten aufgebrachten Motiven (Bildern) entscheidend sein. Hierzu können z.B. geeignete automatische Abrollungstechniken zum Einsatz kommen [8], um großflächige bzw. den gesamten Gefäßkorpus umfassende Motive als weitgehend entzerrungsfreies Bild ganzheitlich zu extrahieren. Motivmerkmale könnten dann mit globalen Formmerkmalen kombiniert werden. Ein längerfristiges Ziel ist die Untersuchung der Frage, inwiefern verschiedene Stile erkannt und für die Suche quantifiziert werden können. Des weiteren gilt es zu ermitteln, ob neben anwendungsabhängig definierten Merkmalen auch Methoden aus dem maschinellen Lernen, wie der Einsatz vortrainierter neuronaler Netze, verwendet werden können, um relevante Merkmale automatisch und zuverlässig zu lernen.

Darüber hinaus wollen wir auch Werkzeuge zur visuellen Exploration von großen Objektmengen untersuchen. Durch Methoden der Dimensionsreduktion können große Mengen von Objekten in einem ähnlichkeitsbasierenden Layout für Vergleichs- und Typisierungszwecke dargestellt werden [9]. Neben den Bildinformationen spielen aber auch Metadaten bei der Analyse von Objekten eine wichtige Rolle. Methoden der Metadatenvisualisierung [10] können hier zum Einsatz kommen, um in Kombination mit Bildähnlichkeit den Kontext für die archäologische Analyse zugänglich zu machen.

[1] Dieses Projekt wird vom Österreichischen Wissenschaftsfonds FWF in Kooperation mit dem Land Steiermark gefördert (Projektnummer P31317-NBL). Wir danken dem Landesmuseum Kärnten sowie der Österreichischen Akademie der Wissenschaften für die Bereitstellung von 3D Objekten. Weitere Informationen und Kontaktdaten zum Projekt finden sich auf https://www.tugraz.at/institute/cgv/research/projects/crosssave-ch.

[2] I. Sipiran – P. Mavridis – T. Schreck, SAS Encyclopedia of Archaeological Sciences, chapter Geometric Matching. Wiley, 2018 (DOI: 10.1002/9781119188230); www.archaeologicalsciencesencyclopedia.com.

[3] Q.-X. Huang – S. Flöry – N. Gelfand – M. Hofer – H. Pottmann, Reassembling fractured objects by geometric matching, ACM Trans. Graph., 25(3):569–578, July 2006 (DOI: 10.1145/1179352.1141925); G. Papaioannou – T. Schreck – A. Andreadis – P. Mavridis – R. Gregor – I. Sipiran – K. Vardis, From reassembly to object completion - a complete systems pipeline. Computing and Cultural Heritage, 10(2), February 2017 (DOI: 10.1145/3009905).

[4] P. Perakis – C. Schellewald – K.F. Gebremariam – T. Theoharis, Simulating Erosion on Cultural Heritage Monuments, Proc. Int. Conference on Cultural Heritage and New Technologies, 2015: https://www.chnt.at/wp-content/uploads/eBook_CHNT20_Perakis_etal_2015.pdf.

[5] E. Trinkl – D. Rieke-Zapp – L. Homer, Face to face - considering the moulding of attic head vases reconsidering Beazley’s groups by quantitative analysis, Journal of Archaeological Science: Reports 21, 2018, 1019-1024 (https://doi.org/10.1016/j.jasrep.2017.07.023); Corpus Vasorum Antiquorum, Band 18: Attisch rotfigurige Kannen und Kopfgefässe. Bearbeitet von Angelika Schöne-Denkinger mit einem Beitrag von Elisabeth Trinkl und Dirk Rieke-Zapp (München 2018) 68-73.

[6] T. Schreck, What features can tell us about shape, IEEE Computer Graphics and Applications, 37(3), 2017, 82-87, 2017 (DOI: 10.1109/MCG.2017.41).

[7] S. Lengauer – A. Komar – A. Labrada – S. Karl – E. Trinkl – R. Preiner – B. Bustos – T. Schreck, Sketch-Aided Retrieval of Incomplete 3D Cultural Heritage Objects, Proc. Eurographics Workshop on 3D Object Retrieval 2019 (DOI: 10.2312/3dor.20191057).

[8] R. Preiner – S. Karl – P. Bayer – T. Schreck, Elastic flattening of painted pottery surfaces. In Proc. EG Workshop on Graphics and Cultural Heritage, 2018 (DOI: 10.2312/gch.20181355).

[9] L. van der Maaten – P. Boon – G. Lange – H. Paijmans – E. Postma, Computer Vision and Machine Learning for Archaeology, Proc. Computer Applications and Quantitative Methods in Archaeology, 2006.

[10] N. Henry – H. Goodell – N. Elmqvist – J.-D. Fekete, 20 Years of Four HCI Conferences: A Visual Exploration, Int. J. Hum. Comput. Interaction 23(3), 2007, 239–285.

![]() © Tobias Schreck, Stefan Lengauer und Reinhold Preiner

© Tobias Schreck, Stefan Lengauer und Reinhold Preiner

e-mail: tobias.schreck@cgv.tugraz.at, s.lengauer@cgv.tugraz.at, r.preiner@cgv.tugraz.at

This article should be cited like this: T. Schreck – St. Lengauer – R. Preiner, Forschungsprojekt Crossmodale Suche und visuelle Exploration von 3D Kulturgutobjekten, Forum Archaeologiae 91/VI/2019 (http://farch.net).